AEX

0.6100

Dans une réalité parallèle, la reine Elisabeth II s'extasie devant des soufflés au fromage, un Saddam Hussein armé jusqu'aux dents parade sur un ring de catch, et le pape Jean-Paul II tente de faire du skateboard.

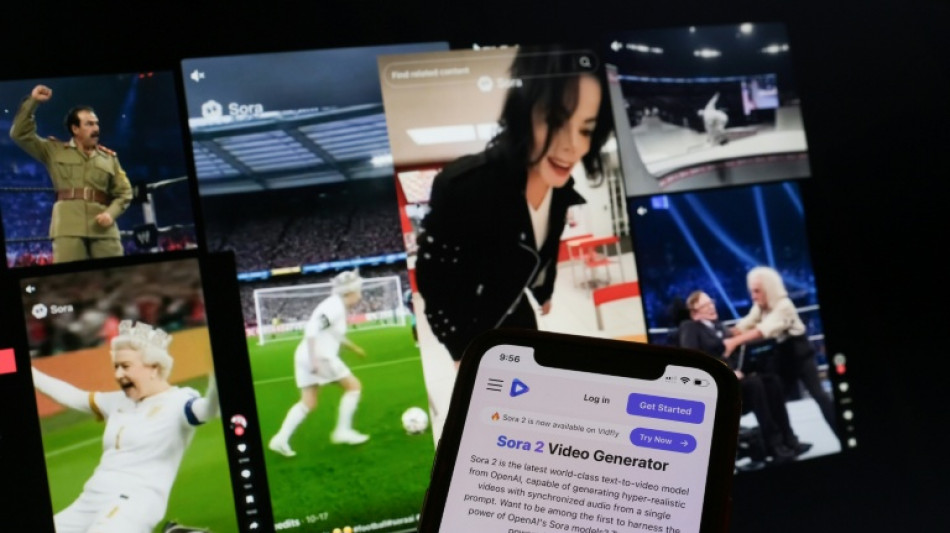

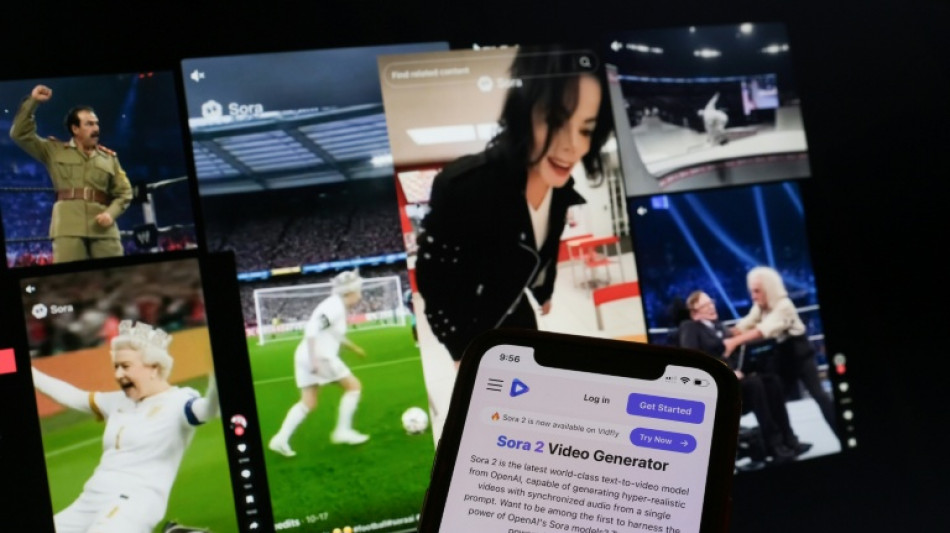

Des vidéos hyperréalistes de célébrités décédées, créées avec des applications comme Sora d'OpenAI, faciles à utiliser, se sont propagées en ligne, suscitant un débat sur le contrôle de l'image des personnes défuntes.

L'application d'OpenAI, lancée en septembre et largement vue comme une machine à "deepfakes" (des contenus hyperréalistes truqués générées par l'IA), a produit depuis sa mise en service un flot de vidéos de figures historiques, dont Winston Churchill, ainsi que de célébrités comme Michael Jackson et Elvis Presley.

Dans un clip TikTok, visionné par l'AFP, la reine Elisabeth II, collier de perles et couronne, arrive à un match de catch en scooter, franchit la corde et bondit sur un catcheur. Dans un autre publié sur Facebook, la reine vante des soufflés au fromage "délicieusement orange" dans une allée de supermarché, tandis qu'une autre encore la montre en train de jouer au football.

Mais toutes les vidéos générées ne prêtent pas à rire.

En octobre, le géant de l'intelligence artificielle a empêché les utilisateurs de son application Sora de créer des vidéos en utilisant l'image de Martin Luther King Jr. suite aux plaintes des héritiers de la figure des droits civiques.

Certains utilisateurs avaient en effet créé des vidéos où il faisait des bruits de singe pendant son célèbre discours "I Have a Dream", tenant des propos grossiers, offensants ou racistes.

- "Exaspérant" -

"Nous entrons dans la +vallée de l'étrange+", explique Constance de Saint Laurent, professeure à l'université Maynooth, en Irlande, en référence à cette théorie selon laquelle lorsqu'un objet atteint un certain degré de ressemblance anthropomorphique ou d'hyperréalisme, il provoque une sensation d'angoisse et de malaise.

"Si, soudain, vous commenciez à recevoir des vidéos d'un proche décédé, ce serait traumatisant", a-t-elle déclaré à l'AFP. "Ces vidéos ont de réelles conséquences".

Ces dernières semaines, les enfants de l'acteur Robin Williams et de l'icône de la cause afro-américaine Malcolm X ont condamné l'utilisation de Sora pour créer des vidéos de leurs pères défunts.

Zelda Williams, la fille de Robin Williams, a ainsi récemment demandé sur Instagram d'arrêter de lui envoyer des vidéos de son père générées par l'IA. C'est "exaspérant", a-t-elle dit.

Bien qu'il existe, "du fait de la liberté d'expression", "un fort intérêt à représenter des figures historiques", les personnalités publiques et leurs familles devraient avoir le contrôle ultime de leur image, a estimé auprès de l'AFP un porte-parole d'OpenAI.

Pour les figures "récemment décédées", a-t-il ajouté, des représentants autorisés ou des ayants droit peuvent désormais demander que leur image ne soit pas utilisée dans Sora.

- "Contrôler l'image" -

"En dépit de ce qu'OpenAI affirme au sujet de sa volonté de permettre aux gens de contrôler leur image, ils ont publié un outil qui, clairement, fait l'inverse", affirme à l'AFP Hany Farid, cofondateur de la société américaine de cybersécurité GetReal Security et professeur à l'Université de Californie à Berkeley.

"S'ils ont (en grande partie) mis fin à la création de vidéos de Martin Luther King Jr., ils n'empêchent pas les utilisateurs de détourner l'identité de nombreuses autres célébrités", déplore-t-il. "Même si OpenAI met en place certaines protections" pour cette figure politique, "il y aura un autre modèle d'IA qui ne le fera pas, et ce problème ne fera donc qu'empirer", fait-il remarquer.

A mesure que les outils avancés d'IA se multiplient, ces risques ne se limitent plus aux figures publiques. Des personnes décédées non célèbres peuvent elles aussi voir leurs noms, leur image et leurs paroles détournés à des fins de manipulation.

Des chercheurs mettent en garde contre la prolifération incontrôlée de ces contenus, baptisés "bouillie d'IA", qui pourraient à terme détourner les utilisateurs des réseaux sociaux.

"Le problème de la désinformation en général, ce n'est pas tant que les gens y croient. Beaucoup n'y croient pas", fait remarquer Mme de Saint Laurent. "Le problème, c'est qu'ils voient des informations réelles et qu'ils ne font plus confiance". Et des outils comme Sora vont "massivement amplifier ce phénomène".

burs-ac-aje/alv

A.Weber--NZN